✅ This article is a compilation of research reviews for study purposes. It was not written for commercial purposes. If there are any issues, it will be deleted.

✅ It's written in Korean, so if you need other language, click the translate button and read it.

논문 소개

초음파 기법은 다른 의료 영상 모달리티와는 다른 확실한 차별점을 가지고 있습니다. 영상을 실시간으로 확인할 수 있다는 점부터 시작하여, 촬영에 (시간, 비용, 금액 등 모든 면에서) cost가 적게 들어가고, 피촬영자에게 해로운 영향을 거의 끼치지 않습니다. 이러한 이유로 초음파 검사는 임산부에게 행하는 산전 초음파 검사 분야에 활발히 활용되고 있습니다.

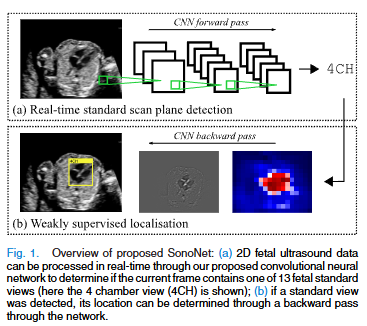

이런 배경에서 이 논문은 “(프로토콜화된 초음파 측정방식이 아닌)자유 초음파 영상에서 태아 표준 스캔면을 실시간으로 검출, 위치 추정하는 최초의 딥러닝 기반 시스템(SonoNet)”을 제안하고 있습니다. 숙련된 산모 초음파 검사자는 13가지 표준 스캔면을 빠르고 정확하게 찾아야 하지만, 이는 경험 의존성이 크고 재현성이 낮아 의료진 부족 문제까지 겹쳐 임상적으로 큰 어려움이 있습니다. 이에 논문의 연구진은 VGG16을 기반으로 한 완전합성곱 신경망(Fully Convolutional Network; FCN)을 설계하여, 대규모 임상 영상(2,649건)에서 표준 스캔면 분류와 bounding box 수준의 위치 추정을 동시에 수행하도록 했습니다. 특히 bounding box가 없는 image-level label만으로 구조 위치를 추정하는 약지도(weakly supervised) 방식을 도입하여 실제 임상 데이터의 제약을 해결한 점이 돋보입니다. 제안된 SonoNet은 초당 25 프레임 이상의 속도로 동작하며, 실제 검사 영상에서 평균 F1-score 0.798, 표준면 회상 검색(Retrieval) 정확도 90%, 위치추정 정확도 77.8%를 달성해 실시간 보조진단 시스템으로서의 가능성을 입증하였습니다.

배경

1) 태아 표준 스캔면 자동 검출이 필요한 이유

18주에서 22주 사이의 중기 산전 검사는 태아 건강을 평가하는 데 필수적이며, 국가별 지침(영국의 경우 FASP 핸드북 등등)에서는 보통 13개 이상의 표준 스캔면(standard scan planes)을 확보하도록 요구한다. 하지만 초음파 영상은 신호대잡음비(SNR)가 낮고 음영/산란 등 다양한 아티팩트가 존재해 안정적인 영상 획득이 쉽지 않다. 특히 촬영 각도/태아 자세/조직 특성의 변화에 따라 같은 구종라도 상이한 형태로 나타나는 경우가 많아 숙련자조차 정확한 스캔면을 찾기 위해 반복 탐색이 필요하고 검사자 간 편차가 매우 크다. 뿐만 아니라 여러 국가에서 숙련된 소노그래퍼 부족 문제까지 겹쳐 진단 품질의 일관성을 유지하기 어려운 실정이다.

또한 기존 장비는 특정 해부학적 모습을 “잘 보이게”하기 위한 기능은 있었으나, 현재 프레임이 정확히 어떤 표준 스캔면인지 자동 판단하는 기능은 미흡했다. 초음파는 실시간성이 핵심이기 때문에, 프레임 단위로 빠르게 스캔면을 분류하고 위치를 알려주는 시스템은 숙련자 뿐 아니라 초심자에게도 중요한 임상적 가치를 가진다.

하지만 실제 임상에서 획득되는 영상은 freehand 방식으로 탐촉자를 자유롭게 움직이며 촬영되므로, 영상 길이가 매우 길고(평균 20,000프레임 이상) 대부분의 프레임이 비표준(background) 영상이다. 따라서 task는 표준 스캔면만 분류하면 되는 정적 이미지 분류 문제가 아니라 극단적인 클래스 불균형과 다양한 영상 조건을 가진 데이터에서 실시간 탐지까지 수행해야 하는 훨씬 어려운 문제이다.

이러한 맥락에서 논문은 “상업적·임상적으로 실질적인 도움을 줄 수 있는 수준의 정확도와 실시간성”을 동시에 목표로 삼으며, 표준 스캔면의 자동 검출 및 약지도 기반 구조 위치추정이라는 새로운 접근을 제안한다.

2) 기존 연구의 한계

초음파 자동 해부학 구조 분석 연구는 오래전부터 진행되어 왔으나, 대부분은 소규모 영상, 제한된 표준면(1~3종), 혹은 단일 sweep 촬영 프로토콜에 국한되어 있었다. 이런 기존 연구들은 전통적인 특징 기반 방법(Random Forest 등)을 사용하여 태아 두개골/심장 등 일부 구조를 감지했지만, freehand 검사에서 나타나는 복잡성을 다루기에는 한계가 컸다.

딥러닝의 도입 이후, CNN 기반 스캔면 분류가 시도되었지만 patch 기반 sliding inference를 사용하여 실시간 동작이 거의 불가능하였고, 지원하는 스캔면 종류도 매우 제한적이었다. 또 sweep 방식 영상은 2~5초 길이의 규격화된 경로를 따라 촬영되지만, 실제 임상 freehand 영상은 긴 시간, 다양한 움직임, 예측 불가능한 촬영 순서를 가진다. 이 때문에 기존 연구는 정적/규격화된 데이터 셋에서는 동작하나, 실제 환경에서 적용하기 어려운 문제가 있었다.

또 하나의 제한은 bounding box 등 정답 위치 라벨의 부족이다. 임상 데이터에서는 수천/수만 장의 프레임에 위치 정보를 수동 주석하는 것은 사실상 불가능하기 때문에, 기존 대부분의 연구는 위치추정을 시도하지 못하거나, 강한 지도(supervised) 방식으로 소규모 데이터만 처리할 수 있었다.

아이디어

앞서 정리했듯 기존 연구는 소수의 표준 스캔면만 다루거나 sweep 기반 영상에만 적용 가능했으며, 실시간 처리나 위치 추정은 사실상 불가능했다. 또한 임상 데이터에서 bounding box 주석을 확보하기 어렵기 때문에 강한 지도 학습 기반의 위치추정 모델은 현실적인 적용이 어려웠다. 이 논문에서는 SonoNet이라는 새로운 구조의 아키텍처를 제안하며 실시간성/약지도/대규모 임상 데이터 적합성이라는 세 가지 요구 조건을 동시에 만족시키는 새로운 초음파 분석 프레임워크를 만들기 위해 노력한다.

이를 해결하기 위해 연구진은 VGG16을 기반으로 완전합성곱(FCN) 구조로 네트워크를 재설계하고, 모든 fully-connected layer를 제거하여 입력 크기에 유연한 class score map을 출력하도록 만들었다. 이 고해상도 score map은 단순 분류 결과 뿐 아니라, 각 위치가 해당 스캔면에 얼마나 기여했는지를 표현하는 공간적 힌트를 제공한다. 이러한 구조적 특성을 활용해 SonoNet은 image-level label 만으로도 saliency map을 역추적(backpropagation)하여 구조의 위치를 추정하는 약지도 방식을 구현한다. 이로써 결국 bouding box 주석 없이도 위치 추정이 가능해진다.()

또한 freehand 초음파 영상의 극단적 클래스 불균형 문제를 해결하기 위해, 연구진은 배경 프레임을 대규모로 샘플링하고 균형 잡힌 mini-batch 전략을 적용했다. 마지막으로, 계산량을 줄인 SonoNet-32 경량 아키텍쳐를 통해 탐지/위치추정 모두 25 fps 이상의 실시간 처리를 달성했다. 이러한 일련의 설계는 기존 연구들이 동시에 충족하지 못했던 대규모 임상 데이터 적합성, 고속성, 약지도 기반 위치추정을 하나의 통합 모델로 구현한 핵심 혁신이라 할 수 있다.

시스템 구조

SonoNet의 시스템 구조는 크게 4가지 구조로 구성된다.

(1) Feature Extractor

(2) Adaptation Layer

(3) Classification Layer

(4) Weakly Supervised Localisation

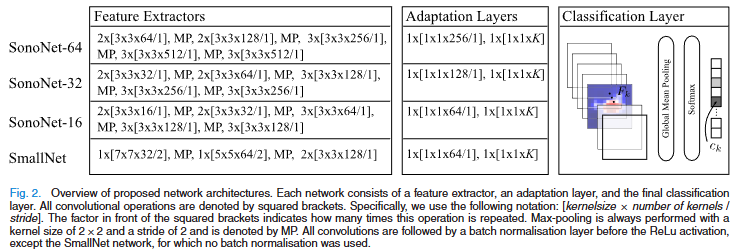

기본 골격은 VGG16이지만, 실시간성과 위치추정을 위해 완전 합성곱 네트워크(Fully Conolutional Network; FCN)로 재해석되었다. 먼저 Feature Extractor는 연속된 3x3 convolution + batch normalization + ReLU 조합 block을 갖고 2x2 max pooling을 반복해 입력(224x288)의 공간적 정보를 단계적으로 축약한다. 이후 fully-connected layer 대신 1x1 convolution으로 구성된 두 단계의 Adaptation Layer가 배치되어 각 공간 위치에 대해 K(현재 논문에선 14)개의 class score map을 직접 산출한다.

이 class score map(Fₖ)은 14x18 해상도로 유지되며 실시간 처리 속도를 확보하면서도 위치 정보를 잃지 않는 구조적 핵심을 가지고 있다.

Classification Layer에서는 score map을 Global Mean Pooling으로 집계하여 softmax 분류를 수행한다. mean을 선택한 이유는, max pooling이 특정 위치의 강한 반응만 반영해 분류 정확도가 떨어지는 반면 mean pooling은 전체 컨텍스트를 활용하여 스캔면 예측이 가능하기 때문이다.

Localisation(위치 추정)은 이 점을 활용한 약지도 방식으로 구현된다. 즉, calss socre map의 활성값을 가중치로 사용하여 해당 클래스 점수 aₖ가 입력 이미지 각 픽셀에 얼마나 민감한지(∂aₖ/∂X)를 역전파로 계산한다. 이를 통해 category-specific salieny map이 생성되고 이를 Gaussian blur → 절대값 변환 → Isodata thresholding으로 후처리하여 bounding box를 얻는다. 이 과정은 bouding box GT 없이도 가능하며, 실제 실시간 추론에서도 25 fps 이상을 달성해 SonoNet의 임상 적용 가능성을 뒷받침한다.

학습 및 추론, 실험

1) 데이터 구성과 전처리

SonoNet은 총 2,649건의 중기 산전 초음파 검사를 기반으로 학습된다. 각 검사에는 소노그래퍼가 저장한 정지 이미지(freeze-frame)뿐 아니라 평균 20,000프레임 이상으로 구성된 freehand 스크리닝 영상이 포함된다. 우선 정지 이미지의 주석(label)을 이용해 13개의 표준 스캔면 클래스를 구축하고 추가적으로 ‘Other’ 군을 만들어 실제 임상에서 자주 보이는 비표준 시점을 반영하였다. 다만 freehand 영상에서 대부분의 프레임은 비표준(background)이므로 전체 데이터의 진짜 분포를 반영하기 위해 랜덤 프레임 샘플링을 통한 대규모 background class 생성(약 11만 장)이 수행된다.

전처리에서는 Doppler overlay 제거, split view 제거, Telea inpainting을 이용한 소노그래퍼의 주석 제거, 224x288 크롭, 표준화(normalization)를 적용했다. 이어 extreme class imbalance를 처리하기 위해 표준 스캔면 + background로 구성된 balanced mini-batch을 도입하여 13개 표준면 x 2장 + background 26장으로 구성해 구조적으로 균형있는 학습이 가능하도록 설계했다.

2) 네트워크 구조

SonoNet은 실시간성을 확보하면서도 약지도 기반 위치추정까지 수행하기 위해 VGG16을 변형한 Fully Convolutional Network(FCN)로 설계되었다. 기존 VGG16의 fully-connected layer를 제거하고, 마지막 단계에 1x1 convolution 기반의 두 단계 Adaptation Layer를 삽입하여 공간 정보를 유지한 채 각 클래스별 활성도를 표현하는 class score map(Fₖ)을 직접 출력한다. 이 score map은 14x18 해상도를 가지며, Frame 당 예측을 빠르게 수행하면서도 saliency 기반 위치 추정을 가능하게 하는 SonoNet의 핵심 구조가 된다. 각 convolution block은 3x3 conv + BatchNorm + ReLU로 구성되며, 2x2 max-pooling으로 해상도를 점진적으로 축소한다. 이후 FCN 구조 덕분에 원본 영상의 공간적 패턴을 손실 없이 유지하며 연산량을 줄일 수 있다. 최종 score map은 mean pooling을 통해 class confidence vector로 변환되는데, 이는 max pooling보다 영상 전체의 문맥 정보를 더 잘 반영하여 분류 성능을 향상시킨다.

VGG16에서 영감을 받은 SonoNet 이외에도 alexNet에서 영감을 받아 파라미터 수가 훨씬 적은 더 간단한 네트워크 아키텍처인 SmallNet도 함께 개발하였다.

연구진은 네트워크 크기에 따른 성능-속도 trade-off를 분석하기 위해 SononNet-62/32/16/SmallNet을 비교했으며, 그중 SonoNet-32가 정확도와 FPS 간 균형을 가장 잘 맞춰 실시간 임상 적용이 가능한 최종 모델로 선정되었다. 이후 약지도 saliency 도출과 bounding box 생성은 이 구조를 기반으로 수행된다.

3) 학습 전략 및 결과 평가 방식

(A) 도메인 갭 해결과 데이터 결합 전략

Freeze-frame 이미지와 영상 프레임은 해상도, 압축 방식 등이 달라 도메인 차이가 존재한다(비디오 프레임은 해상도가 약간 낮고 압축되어 있음). 이를 완화하기 위해 연구진은 freeze-frame과 가장 유사한 video frame을 자동 매칭하여 이미지 + 영상 결합 훈련 데이터셋을 구성했고 이 중 20%를 검증에 사용했다. 이를 통해 모델은 두 도메인의 특성을 모두 학습하며 실제 추론 환경과 더욱 가까운 조건을 재현한다.

(B) Class imbalance 해결을 위한 균형 샘플링

freehand 영상에서 background가 지나치게 많아 학습 시 표준 스캔면의 신호가 쉽게 묻히는 “클래스 불균형” 문제가 발생한다. 이를 해결하기 위해 미니배치 경사 하강법과 함께 batch를 클래스별 표준면 2장 + background 26장으로 구성하는 균형 샘플링 기법을 적용했다. 이는 실제 임상 분포를 반영하면서도 gradient가 표준면 정보에 의해 안정적으로 업데이트되도록 설계된 전략이다.

(C) 학습 기법 및 최적화

논문에서 제시한 모든 네트워크의 최적화는 SGD + Nesterov momentum(0.9), categorical cross-entropy loss, 초기 학습률 0.1을 사용했다. 단, 몇몇 학습 케이스에서 초기 학습률 0.1이 즉시 수렴하기에는 너무 공격적이기 때문에 초기 500 iterations 동안 LR warm-up(0.01→0.1)을 적용하여 깊은 네트워크에서 발생하는 early divergence를 방지했다. SmallNet은 BatchNorm이 없어 안정성을 위해 LR을 더 낮게 설정(0.001)했다. 데이터 증강으로는 scale augmentation(174x174 or 224x224 crop), random flip, ±25° rotation을 적용해 freehand 촬영의 불규칙성을 학습할 수 있도록 했다. 학습은 NVIDIA GTX 1080 환경에서 약 2일 소요된다.

(D) 추론 방식: Real-time Frame Annotation

테스트 시 각 224x288 프레임은 단일 forward-pass로 14x18 사이즈의 class score map(Fₖ)을 출력하며, 이를 mean pooling 해 각 범주 k에 대한 단일 클래스 점수 ak를 얻었다. 그 후 softmax 계층은 각 프레임의 클래스 신뢰도 ck를 계산한다. 최종 예측은 가장 높은 신뢰도를 가진 출력으로 결정되었다.

이 구조 덕분에 SonoNet-32는 25 fps 이상의 실시간 처리 속도를 확보하여 실제 초음파 영상의 frame rate와 동일한 수준에서 동작할 수 있다.

(E) 평가 방식

논문은 다음 세 가지 축으로 모델을 평가했다.

1. Real-Time Scan Plane Detection

freeze-frame에 대응하는 영상 프레임과 대규모 background 프레임을 포함한 test set 전체에서, 표준 스캔면을 정확히 탐지하는지 Precision, Recall, F1-score로 평가. 이는 실제 스크리닝 환경의 “표준면 vs 압도적 background” 문제를 직접적으로 반영한 중요한 지표다.

2. Retrospective Scan Plane Retrieval

영상 전체에 대해 클래스 confidence curve를 생성한 뒤, 각 클래스별 최고점을 가지는 프레임을 1장씩 자동 선택하는 방식. 20k 프레임 이상의 임상 영상을 1-shot retrieval로 평가하여 모델의 탐색 안정성과 임상적 활용성을 검증한다.

3. Weakly Supervised Localisation 평가

영상 650장에 대해 bounding box를 수동 주석하고, 모델이 자동 산출한 bounding box와의 IoU≥0.5 비율로 정확도를 계산한다. bounding box GT 없이 학습되었기에 이 실험은 약지도 모델의 구조적 성능을 검증하는 핵심 평가다.

4) 표준 스캔면 탐지 실험(Real-Time Scan Plane Detection) 평가

Real-Time Scan Plane Detection은 SonoNet의 핵심 기능 중 하나로, 실제 초음파 영상 스트림에서 표준 스캔면을 정확하게 탐지하는 능력을 검증하는 실험이다. 테스트 셋은 freeze-frame에 매칭되는 실제 영상 프레임과 대규모 background 프레임(비표준면)으로 구성되어 임상 환경을 충실히 반영한다. 이 상황은 표준면:background 비율이 약 1:24에 달해 극단적으로 어려운 조건이었다.

그럼에도 SonoNet-32는 평균 F1-score 0.798을 달성하였으며, 몇몇 주요 뷰(Brain TV, Brain TC, Abdomen, Femur 등)는 0.9 이상의 뛰어난 성능을 보였다. 반면 cardiac views(RVOT, 3VV)는 해부학적 유사성과 촬영 각도 민감성 때문에 오분류가 증가하여 상대적으로 낮은 F1-score를 기록했다.

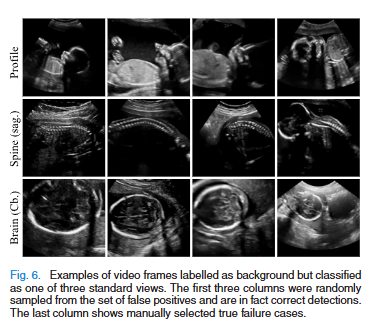

흥미로운 점은 다수의 false-positive가 실제로는 background로 잘못 라벨링 된 “숨겨진 표준면”이었다는 것이다. 즉, 모델은 GT보다 잘 찾은 경우가 상당수 존재하며, 논문에서도 보고된 실제 영상 검증에서는 false-positive 중 상당수가 임상적으로 진짜 표준면이었다. 이는 모델 성능이 표기된 수치보다 더 높을 가능성을 시사한다.

추가적으로 SonoNet-32는 forward pass만으로 25 fps 이상의 처리 속도를 기록해 실시간 초음파 장비에 적용 가능한 충분한 속도를 확보했다(실시간 영상화를 위한 문헌 상의 명시적인 합의는 없지만 일반적으로 사용되는 수치는 25 fps이다).

5) 표준 스캔면 회상 검색(Retrospective Retrieval) 평가

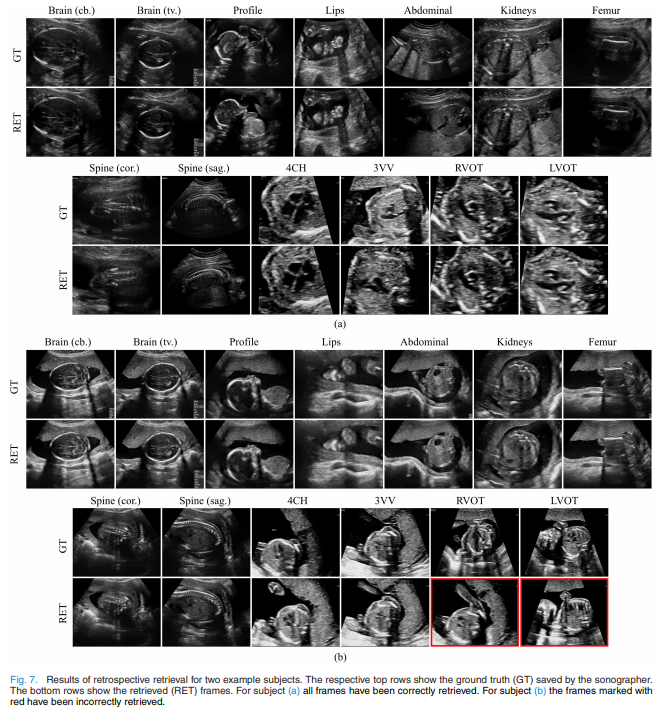

Retrospective Retrieval은 한 영상(평균 20,321 frames)에서 각 표준 스캔면을 단 1장의 프레임으로 자동 요약하는 작업으로, Sonographer가 수행해 온 수동 영상 탐색을 자동화할 수 있는 중요한 기능이다. 방법은 각 클래스별 confidence curve를 생성한 뒤 가장 확률이 높은 프레임을 선택하는 방식이다.

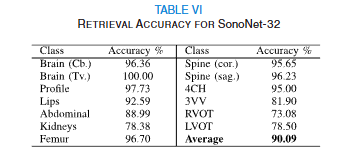

110개 test 영상에 대해 두 명의 임상 전문가가 직접 검증한 결과, SonoNet-32는 평균 90.09%의 Retrieval Accuracy를 기록하고 비심장(view)에서는 평균 95.52%까지 도달하여 매우 높은 신뢰성을 보였다. 오분류는 대부분 cardiac view에서 발생했으며, 이는 3VV·RVOT·LVOT 등이 촬영 각도에 극도로 민감하고 형태적 차이가 작기 때문이다.

정성적 결과에서도 많은 경우 모델이 선택한 프레임은 GT freeze-frame과 시각적으로 거의 동일한 품질을 보였으며, 때로는 오히려 더 선명한 구조를 포함한 프레임을 선택하기도 했다. 이는 SonoNet이 단순 분류기가 아니라 실제 초음파 흐름을 이해하며 가장 임상적으로 적합한 프레임을 재구성할 수 있음을 의미한다.

영상 전체 탐색과 표준 스캔면 추출을 자동화할 수 있다는 점에서, 이 기능은 비전문가의 검사 품질 향상, 영상 보고서 자동 생성에도 직접적으로 활용될 수 있다.

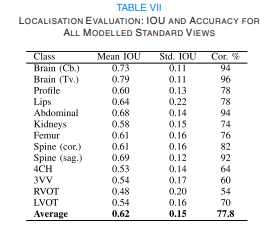

6) 약지도 기반 위치추정(Weakly Supervised Localisation) 평가

약지도 localisation 평가는 총 650장의 이미지(13개 스캔면 x 50장)를 대상으로 bounding box GT를 수동으로 구축해 비교하는 방식으로 수행되었다. 평가는 객체 검출 분야 표준 지표인 IoU ≥ 0.5 기준으로 측정되었다. 그 결과 SonoNet-32는 전체 평균 77.8% accuracy를 기록했다. 심장(view)에서는 62%로 다소 낮았으나 나머지 표준 스캔면에서는 평균 84.9%로 매우 안정적인 위치추정 성능을 보였다.

결과 이미지를 보면 모델은 구조의 전체 윤곽을 완전하게 감싸지 못한 경우가 실패 원인의 대부분이었다. 예를 들어 Abdominal view에서는 위(stomach)가 saliency 중심이 되어 box가 과도하게 축소되거나, Femur view에서는 반대쪽 대퇴골까지 잡혀 box가 과대 확장되는 경우가 있었다. 이는 약지도 특성상 가장 중요한 특징에 집중하는 경향 때문으로 해석된다.

그럼에도 모델은 구조 위치를 완전히 놓치는 경우가 거의 없었고, saliency 기반 국소화가 전체적으로 해부학적 중심부를 안정적으로 포착하는 것으로 나타났다. 또한 SonoNet-64를 제외한 모든 네트워크에서 localisation 과정의 backward pass가 최적화되어 실시간 처리 속도(25 fps 이상)를 그대로 유지한다는 점은 임상적 활용 가능성을 크게 높이는 요소이다.

이 방식은 bouding box GT가 거의 존재하지 않는 초음파 분야의 데이터 특성과 특히 잘 맞으며, SonoNet의 약지도 접근이 실질적, 현실적인 선택임을 뒷받침한다.

결과 해석

이 논문에 언급된 SonoNet 실험 결과는 세 가지 핵심적인 메시지를 전달한다.

첫 번째로, 모델은 극단적인 임상 환경(표준 스캔면보다 압도적으로 많은 background 프레임이 존재하는 freehand 초음파 상황)에서도 높은 탐지 성능과 실시간 처리 속도를 동시에 달성했다. 이는 단순한 이미지 분류기를 넘어 실제 임상 workflow에 바로 적용할 수 있는 수준의 안정성을 의미한다. 특히 많은 false-positive가 실제로는 라벨링 오류였다는 사실은 모델의 실제 성능이 보고치보다 더 높을 가능성을 시사한다.

두 번째로, 회상 검색(Retrospective retrieval)은 SonoNet이 단순히 순간적인 스캔면을 인식하는 데 그치지 않고, 길고 복잡한 freehand 영상 속에서 특정 표준면을 가장 잘 나타내는 한 장의 프레임으로 효과적으로 선택해 낼 수 있음을 보여준다. 이는 초음파 영상 보고서 자동 생성, 초보자 교육, 자동 품질 관리(QA)의 핵심 기능이 될 수 있다.

마지막으로, 위치 추정(Localisation)에서는 bounding box GT 없이도 해부학적 구조의 위치를 상당히 정확하게 포착했다. cardiac view와 같이 형태적 다양성이 크거나 구조 경계가 모호한 경우 성능이 다소 낮았지만 전체적으로 구조의 핵심 영역을 놓치지 않았으며 임상 보조용 시각화로 충분히 의미 있는 품질을 얻었다. 특히 완전 합성곱 구조에서 생성되는 class score map을 활용한 약지도 saliency 기반 추론은 초음파에서 흔한 “위치주석 부족 문제”를 해결한 중요한 기여다.

종합적으로 봤을 때, SonoNet은 실시간성/정확성/위치추정/약지도 학습이라는 네 요소를 통합하며 기존 연구들이 분리된 방식으로만 해결하던 문제들을 하나의 모델 내에서 완성했다. 이는 초음파 AI가 실제 임상에 진입하기 위한 실질적인 기반 기술을 보여준다는 점에서 큰 의의가 있다.

댓글