논문 소개

본 논문은 평면파 초음파 이미징 기술의 저해상도 문제를 해결하기 위해 제안된 ARU-GAN(U-shaped GAN based on Attention and Residual connection) 모델을 소개합니다. 평면파 영상은 초고속 촬영이 가능하지만 spatial resolution와 contrast-noise ratio(이하 CNR)가 낮다는 한계를 가지며 기존 Coherent Plane-wave Compounding(이하 CPWC) 방식은 해상도 향상 대신 frame rate을 희생합니다. 이를 해결하기 위해 저자들은 Full-scale Skip-connection U-shaped Generator(FSUG)와 Residual Attention Patch Discriminator(RAPD)를 결합한 GAN 구조를 새로이 설계하였습니다. 특히 pixel attention과 minus attention을 통해 저주파 전역 정보와 고주파 세부 정보를 동시에 활용하고 MS-SSIM 및 perceptual loss를 포함한 결합 loss function을 적용하였습니다. PICMUS 2016 데이터셋 실험에서 FWHM, CR, CNR, PSNR, CW-SSIM 등 주요 지표에서 기존 GAN 및 전통적 빔포밍 기법 대비 일관되게 향상된 성능을 보이며, 초음파 영상 super resolution 재구성에 대한 실용적 가능성을 제시했다는 의의를 가지고 있습니다.

배경

본 연구의 배경은 평면파 초음파 영상이 갖는 spatial resolution과 temparal resolution 간의 trade-off 문제에서 출발한다. 기존의 linve-scan 방식은 안정적인 영상 품질을 제공할 수 있었지만 프레임 속도가 제한적이며 이를 보완하기 위해 등장한 평면파 기술은 영상을 초당 수천 프레임 이상 촬영할 수 있게 했다. 실시간 영상화를 위한 FPS의 마지노 선이 30~40 FPS인걸 생각하면 평면파는 이를 훨씬 웃도는 고속 촬영이 가능했다.

그러나 단일 빔 기반 평면파 영상은 Spatial resolution과 Contrast가 너무 낮아 임상 적용에 한계가 뚜렷했다. 이를 개선하기 위해 CPWC, MV, CF, GCF 등 빔포밍 기반 합성 기법이 개발되었으나, 각 방법은 특정 환경에 의존적이며 이 또한 temporal resolution 저하, 계산 복잡도 증가 라는 trade-off 관계에서 벗어나지 못했다.

최근에는 데이터 기반의 딥러닝 접근법이 다수 도입되어 RF 신호 기반 혹은 영상 기반의 재구성 방식이 제안되었다. RF 기반 방법은 물리적 타당성이 높지만 데이터 취득 품질에 민감하고 학습이 복잡하다. 반면 영상 기반 방법은 구현이 용이하고 적응성이 높으나, 고주파 세부 정보 추출과 전역-국소 특징 통합이 불분명하다는 한계가 있다. 이러한 맥락에서 본 논문은 초고속성을 유지하면서도 영상 품질을 향상시킬 수 있는 새로운 GAN 기반의 super-resolution 재구성 모델의 필요성을 제기한다.

아이디어

평면파 초음파 영상은 단일 빔 기반으로 초고속 촬영이 가능하지만, 주파수 관점에서 보면 저주파 성분은 비교적 유지되는 반면 고주파 성분은 충분히 복원되지 못한다.

위 초음파 영상은 블로그 주인장이 직접 촬영한 Liver plane wave 이미지이다. 왼쪽은 0° 각도 plain wave에 대한 시각화 사진이고 오른쪽 이미지는 75 angles(+16° ~ -16°)의 평면파 이미지를 compounding한 결과이다. 실제로 왼쪽 이미지는 고주파 성분의 복원이 충분치 못하여 20 mm 부근의 liver 경계 정보와 35mm 부근의 vessel 경계 정보가 뚜렷하지 못함을 알 수 있다.

저주파는 조직의 전반적인 구조와 밝기 분포를 반영하지만, 고주파는 경계, 세부 질감, 병변 윤곽과 같은 공간 해상도 정보를 담당한다. CPWC는 다중 각도 합성을 통해 고주파 성분을 보완하지만 이는 시간 해상도와 계산비용을 희생한다. 따라서 단일 평면파 영상으로부터 고주파 정보를 복원하면서 전역 구조를 유지하는 것이 핵심 과제로 정의된다.

초음파 영상은 speckle noise와 낮은 대비로 인해 중요한 구조와 배경이 혼재되어 있으며, 모든 특징을 동일하게 처리하는 일반 CNN 구조는 병변 경계나 낭종 윤곽과 같은 핵심 영역을 충분히 강조하지 못한다. 이에 선택적으로 정보를 재가중하는 attention 기법이 필요하다. 본 연구는 attention을 주파수 관점에서 분리하여 pixel attention은 전역 저주파 정보를 강화하고 구조적 안정성을 유지하도록 설계한 반면 minus attention은 평균화된 저주파 성분을 제거하여 고주파 잔차를 강조함으로써 경계와 세부 질감을 복원한다. 이는 단순히 채널/공간 attention을 넘어서 네트워크 내부에서 저주파와 고주파 정보를 암묵적으로 분해하고 재통합하는 주파수 인지적 설계라는 점에서 의의를 가진다.

시스템 구조

ARU-GAN은 단일 평면파 영상을 입력으로 받아 75-beam CPWC 합성 영상을 목표로 학습하는 GAN 기반 초해상도 재구성 모델이다. 전체 구조는 Fig. 1에 제시되어 있으며 후술할 Full-scale skip-connection U-shaped generator(이하 FSUG) 생성기와 Residual attention patch discriminator(이하 RAPD) 로 구성된다.

FSUG(Full-scale skip-connection U-shaped generator)

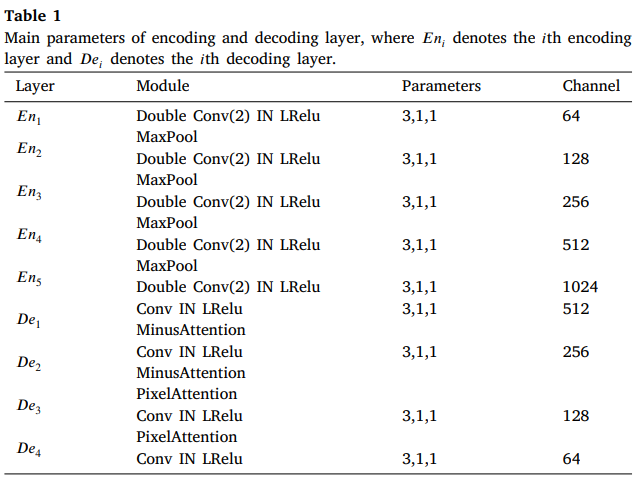

FSUG는 U-Net 기반의 encoder-decoder 구조에 full-scale skip-connection을 확장한 생성기다(Fig. 2 참고). LR은 low resolution, SR은 super resolution을 의미한다.

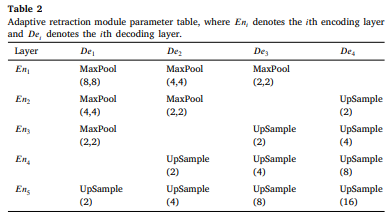

단순한 대응 레벨의 연결 구조가 아니라 각 인코더 층의 feature map을 다양한 해상도로 upsampling 또는 max pooling하며 모든 디코더 층으로 연결한다(Table 2). 이를 통해 multi scale 정보를 통합한다.

인코더와 디코더 층의 채널 구성은 Table 1에 정리되어 있다. feature generation task에서 generation distribution과 target data의 분포에 일관성을 보장하기 위해서 전통적으로 사용하는 Batch Normalisation이 아닌 Instance Normalisation(IN)을 사용하여 이미지 간의 독립성을 유지했으며 생성 결과가 각 독립적인 이미지 인스턴스에 더 의존하도록 보장했다. 또한 계산 과정 중 gradient 소실 문제를 피하기 위해 전통적 기법인 ReLU 대신 Leaky ReLU를 활용했다. 추가적으로 훈련 과정 중 과적합을 방지하기 위해 Dropout을 설정하였고 디코더 상위층에는 minus attention, 하위층에는 pixel attention을 배치하여 주파수 특성을 분리 처리한다.

RAPD(Residual attention patch discriminator)

RAPD는 PatchGAN 구조를 기반으로 하되, Res-Att block을 삽입하여 설계되었다(Fig. 3 참조). 세부적인 파라미터에 대해서는 Table 3를 참고하자.

각 블록은 residual 연결과 Convolutional Block Attention Module (CBAM)을 포함하여 고주파 세부 정보와 저주파 전역 정보를 동시에 유지한다. Patch 단위 판별을 수행함으로써 국소 texture의 현실성을 강화하고 GAN 학습의 판별력을 향상시킨다.

Attention mechanism

ARU-GAN은 생성기와 판별기 내부에 세 가지 attention 모듈을 배치하여 저주파-고주파 정보를 분리 및 통합한다.

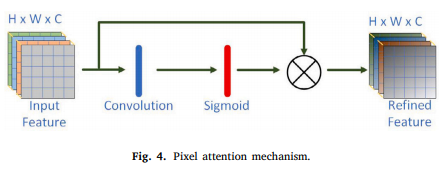

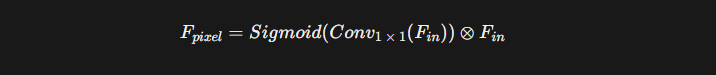

Pixel attention mechanism

Pixel attention은 전역 저주파 정보를 강조하기 위한 모듈로, Fig. 4에 그 세부 구조가 제시되어 있다. 입력 feature map F_in에 대해 1 x 1 convolution을 수행한 뒤 sigmoid 함수를 통해 각 pixel 위치의 attention coefficient를 계산한다. 이후 해당 가중치를 원 feature map과 곱하여 출력 F_pixel을 생성한다. 이는 채널과 공간 attention을 분리하지 않고 단일 연산으로 통합함으로써 파라미터 증가를 억제하면서도 shallow feature 손실을 방지한다. 디코딩 하위 단계에 적용되어 global structure 복원을 보완한다.

수식으로 표현하면 아래와 같다.

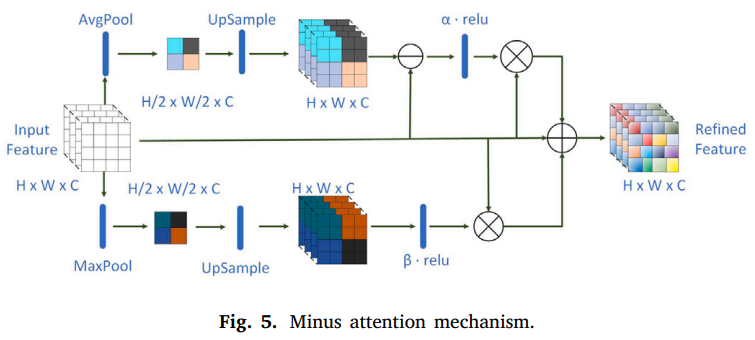

Minus attention mechanism

Minus attention은 고주파 세부 정보를 강조하기 위한 설계로 Fig. 5에 제시되어 있다. 입력 feature map F_in에서 average pooling을 통해 저주파 성분 F_avg를 추출하고, 이를 원 feature에서 감산하여 잔차 형태의 고주파 성분을 강조한다. 동시에 max pooling 기반으로 sparse한 고주파 성분 F_max를 결합한다. 최종적으로 아래 수식 형태로 계산된다.

이는 저주파 제거 기반의 암묵적 주파수 분해를 목적으로 디코딩의 상위 단계에 적용되어 경계와 질감 복원에 기여한다.

💡💡💡디코딩 레이어에서 초기 깊은 층은 공간해상도가 낮아서 feature들의 특징이 추상적이다. 이에 반해 디코딩 레이어 후반의 얕은 층은 공간해상도가 높아 spatial한 detail의 특징이 살아나게 된다. 즉, 깊은 디코딩 층은 coarse한 structure가 복원되는 단계고 얕은 디코딩 층은 세부 edge와 texture가 복원되는 단계이다.

따라서 깊은 층에서는 downsampling을 여러 번 거치고 이미 저주파 성분(global feature)이 지배적인 상태에서 고주파 성분을 다시 강조해주는 보정이 필요하다. 따라서 논문의 저자들은 bottom-up 디코딩 초기에 minus attention을 배치하였다.

이와 반대로 얕은 층에서는 spatial detail은 이미 충분하게 복원되었고 skip connection을 통해 high-resolution feature가 유입되었으나 upsampling을 여러번 반복하게 되어 global context의 복원이 약화되어 있으므로 각 pixel 위치에 global-aware weight를 부여하는 pixel attnetion을 배치하여 저주파 구조를 보강하고 구조적 일관성을 확보하는 역할을 수행하게 된다.

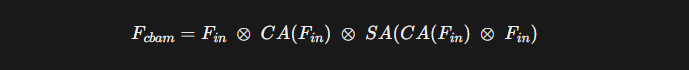

Convolutional block attention module(CBAM)

CBAM은 RAPD 내부 Res-Att block에 포함되는 구조로 Fig. 6에서 제시하고 있다. 채널 attention과 공간 attention을 순차적으로 적용하는 방식으로 AvgPool과 MaxPool 기반으로 채널 가중치를 계산한 후, 7 x 7 convolution을 통해 공간 가중치를 산출한다. 이를 통해 판별기의 edge 및 texture 민감도를 강화한다.

수식으로 표현한다면 아래와 같다.

Loss function

ARU-GAN은 BCE 기반의 adversarial loss, MS-SSIM loss, perceptual loss를 결합한 복합 손실합수를 사용한다. 이는 분포 정합성과 구조적 유사성을 동시에 최적화한다. 아래 수식은 전체 Loss를 구하기 위한 식이다.

Adversarial loss function(적대적 손실 함수)

본 연구는 LSGAN, WGAN과 비교한 뒤 BCE 기반의 adversarial loss function을 채택하였다. 아래 수식을 참고하자.

생성기 출력 I_SR과 실제 영상 I_GT에 대해 판별기 확률값을 이용하여 이진 분류 손실을 계산한다. 이는 분포 수준에서의 realism을 학습하도록 유도하며, GAN의 기본적 대립 학습 구조를 유지한다.

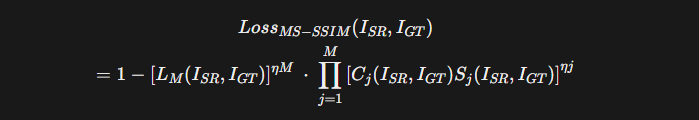

Multi-scale structural similarity index measurement loss function(MS-SSIM)

MS-SSIM loss는 밝기(L), 대비(C), 구조(S)의 다중 스케일 유사성을 동시에 고려할 수 있다. 아래 수식을 참고하자.

생성된 이미지와 실제 이미지 간의 휘도 차이가 L(⋅)이고 대비 변화가 C(⋅), 구조적 유사성을 S(⋅)로 표현하고 있다. 또한 M은 이미지 윈도우의 스케일 크기를 나타내고, nj는 스케일 크기 j에서의 스케일 파라미터를 나타내고 있다. 이 손실 함수는 단일 픽셀의 오차가 아닌 구조적 유사성을 기준으로 학습 방향을 조정하여 시각적 품질과 조직 구조 보존을 강화한다.

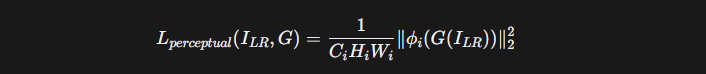

Perceptual loss function

1.4.1.과 1.4.2.에 소개된 손실 함수는 모델을 실제 이미지 품질에 맞게 조정하지만 그럼에도 불구하고 이미지에 대한 고수준 구조 정보를 정확하게 포착하기에는 무리가 있다. 따라서 아래 식에 묘사된 바와 같이 생성된 이미지가 단순히 픽셀 유사도를 넘어서 실제 이미지의 texture와 의미적 구조의 유사성을 확보하도록 지각 손실 함수를 통합하였다.

여기서 ϕ_i는 사전 훈련된 VGG 네트워크의 i번째 계층의 활성화 맵을 나타내며, C_i, H_i, W_i는 각각 특징 맵 ϕ_i의 채널 크기, 높이, 너비를 나타낸다.

학습 및 추론, 실험

Dataset

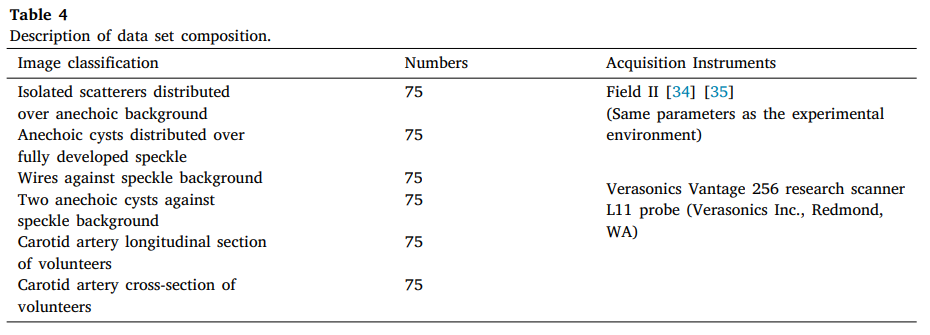

본 연구는 PICMUS 2016 plane-wave imaging dataset을 사용하였다. 데이터는 IQ/RF 형식이며 송신 각도 범위는 [-16°, 16°]이다. Table 4에 따르면, 데이터는 시뮬레이션(point scatterer, cyst), 실험(wire, cyst), 그리고 in-vivo(경동맥 종/횡단면)로 구성되며 각 75개 각도 plane-wave 이미지가 존재한다. 데이터셋 구성은 Table 4에 상세히 기술되어 있다.

75-beam CPWC 합성 결과를 ground truth로 설정하였다. Gaussian noise 추가와 flip augmentation을 통해 총 1800세트로 확장하였으며 8:2 비율로 1350개 학습, 450개 테스트로 분할하였다.

Details

본 연구에서 제안된 네트워크 모델은 생성자에는 Adam optimizer를 파별자에는 RMSprop optimizer를 사용하여 훈련되었으며, 학습률은 0.01로 초기화되었고, ReduceLROnPlateau 학습률 감소 전략이 추가되었다. Minus attention mechanism의 α와 β 값은 0.8로 설정되었다. 모델은 RTX 3060 GPU에서 수렴이 달성될 때까지 최대 120 에폭동안 훈련했다.

Metrics

평가 지표는 대상 유형에 따라 다르게 설정되었다.

- Point target: 공간 해상도를 평가하기 위해 FWHM(Full Width at Half Maximum)을 사용했다.

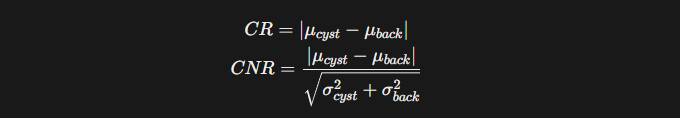

- Cyst target: 대비 특성 평가를 위해 CR(Contrast)와 CNR(Contrast to Nois Ratio)를 사용했다. CR은 낭종과 배경 평균의 차이, CNR은 분산을 고려한 대비 안정성을 반영한다.

- In-vivo target: PSNR, CW-SSIM, NCC를 사용하였다. PSNR은 재구성 정확도, CW-SSIM은 복소 웨이블릿 기반 구조 유사성, NCC는 공분산 기반 상관도를 평가한다. 여기서 c_I_SR과 c_I_GT는 각각 I_SR과 I_GT의 복소 웨이블릿 변환 신호를 나타내며 K는 안정화 상수이다.

대상별로 지표를 달리 적용함으로써 구조, 대비, 텍스처 측면을 다각도로 검증하였다.

Contrast Experiments

Point targets

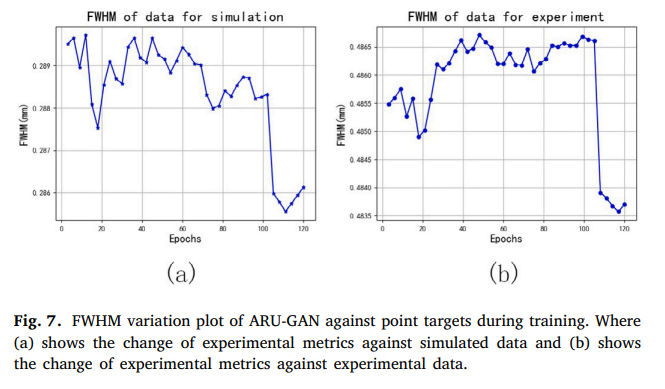

Fig. 7은 학습 중 FWHM 변화 곡선을 보여준다. 시뮬레이션 데이터에서는 약 100 epoch 이후 0.286 이하로 안정화되며, 실험 데이터에서는 0.4835 ~ 0.4840 mm 범위에서 수렴하였다.

Table 5에 따르면, 시뮬레이션 데이터에서는 AUGAN(0.256 mm)이 최저 FWHM을 기록하였고 ARU-GAN은 0.277mm로 두 번째 성능을 보였다. 그러나 실험 데이터에서는 ARU-GAN이 0.424mm로 최저값을 기록하여 ResGAN(0.484mm) 대비 0.060 mm 개선을 달성하였다.

Fig. 8은 시각적 비교 결과를 제시한다. (a)는 단일 beam, (b)는 75-beam CPWC(GT), (c) ~ (h)는 각 DL 방법 결과이다. ARU-GAN은 point spread 폭이 가장 좁고 중심 에너지 집중도가 높게 나타났다.

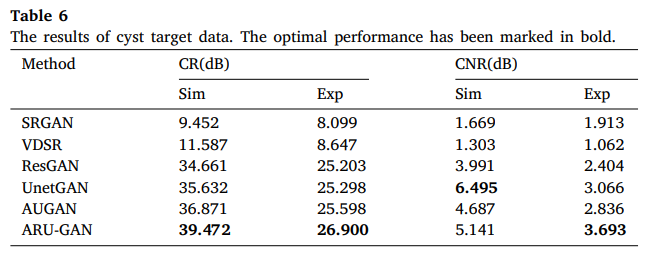

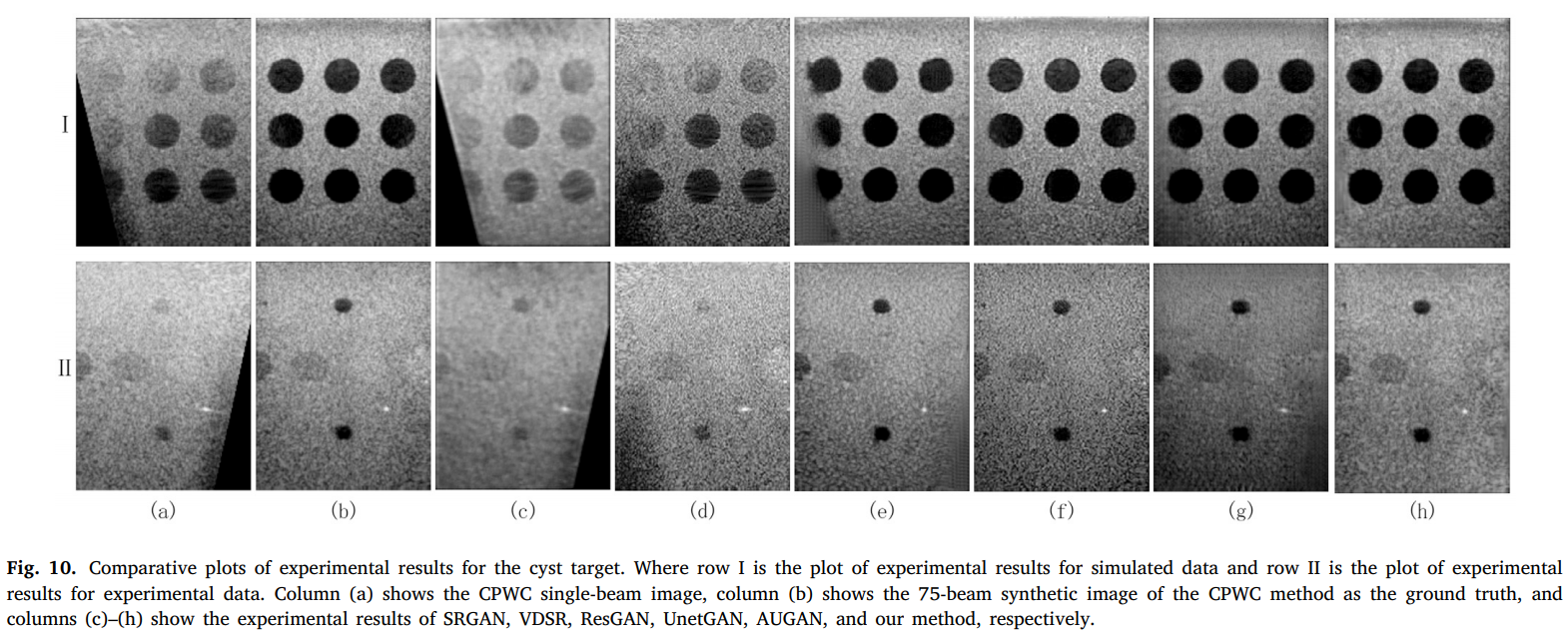

Cyst targets

Fig. 9는 CR과 CNR의 학습 변화 추이를 보여준다. 약 80 epoch 이후 수렴하며, 시뮬레이션 데이터는 CR이 39dB 이상에서 안정화된다.

Table 6에 따르면 ARU-GAN은 시뮬레이션에서 CR 39.472 dB, 실험에서 26.900 dB로 최고 성능을 보였다. 이는 AUGAN 대비 각각 7.05%, 5.09% 개선이다. CNR에서는 시뮬레이션에서 UnetGAN이 다소 우수했으나, 실험 데이터에서는 ARU-GAN이 3.693 dB로 최고 성능을 기록하였다.

Fig. 10은 시각 비교를 보여주고 있다. ARU-GAN은 낭종 경계가 선명하며, 내부 저에코 영역이 균일하게 유지되어 contrast 보존이 우수함을 확인할 수 있다.

In-vivo targets

Fig. 11은 PSNR, CW-SSIM, NCC의 학습 곡선을 제시한다. 약 100~110 epoch에서 안정화되며 이후 변화 폭은 2% 이하로 감소한다.

Table 7에 따르면 ARU-GAN은 PSNR 26.508 dB, CW-SSIM 0.876, NCC 0.943으로 모든 지표에서 최고 성능을 보였다. 기존 방법 대비 PSNR은 최소 11.94%, CW-SSIM은 17.11%, NCC는 2.17% 이상 개선되었다.

Fig. 12는 경동맥 횡단 및 종단면 결과를 비교한다. ARU-GAN은 혈관 벽 경계와 조직 텍스처를 보다 선명하게 복원하며 특히 저대비 영역의 세부 구조 표현이 우수하다.

Contrast experiment with non-deep approaches

Table 8은 전통적 빔포밍 기법(CPWC, CF, GCF, MV)과의 비교 결과를 제시한다.

- Point target: ARU-GAN은 시뮬레이션 0.277 mm, 실험 0.424 mm로 CF 대비 각각 0.015 mm, 0.006 mm 개선하였다. 이는 전통 합성 대비 더 좁은 point spread를 의미한다.

- Cyst target: CR을 기준으로 ARU-GAN은 시뮬레이션 39.472 dB, 실험 26.508 dB로 MV 대비 각각 10.96%, 3.89% 개선을 보였다. 이는 경계 대비 향상과 배경 잡음 억제를 동시에 달성했음을 의미한다.

- In-vivo target: PSNR은 GCF(36.561 dB)가 더 높게 나타났으나, 이는 전통 기법이 beam 정보를 직접 활용하기 때문이다. 반면 ARU-GAN은 구조적 유사성(CW-SSIM, NCC)에서 우수하며 시각적 품질은 높게 유지된다.

위 결과를 종합했을 때 ARU-GAN은 singal-domain 기반 기법 대비 PSNR에서는 열세일 수 있으나, texture 및 구조 보존 측면에서 경쟁력 있는 결과를 보이며 image-domain 학습의 실용성을 입증한다.

Ablation experiments

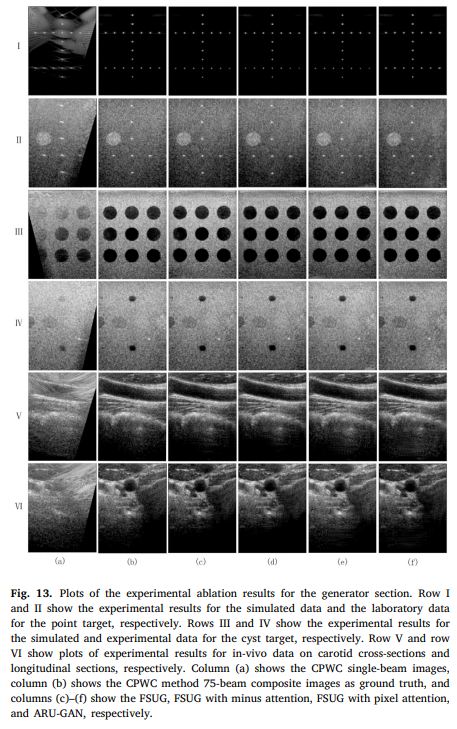

본 연구는 생성기, 판별기, 손실함수 각 구성 요소의 기여도를 검증하기 위해 단계적 소거 실험을 수행하였다. 결과는 Table 9 ~ 11과 Fig.13 ~ 15에 제시된다.

Ablation experiments for generator

생성기 ablation은 FSUG 단독 구조, Minus attention 추가, Pixel attention 추가, 그리고 두 attention 동시 적용(ARU-GAN) 네 가지 조건으로 수행되었다.

Table 9를 보자. Point target에서 FSUG는 0.284 mm(Sim), 0.499 mm(Exp)를 기록하였다. Minus attention 또는 Pixel attention을 하나만 추가하면 오히려 약화된 결과를 보였다. 두 attention을 함께 적용하면 0.277/0.424 mm로 가장 낮은 FWHM을 달성하였다.

Cyst target에서 Pixel attention은 실험 데이터 CR을 25.411에서 26.251 dB로 개선하였고 최종 구조는 CR 39.472/26.900 dB, CNR 5.141/3.693 dB로 최고 성능을 보였다.

In-vivo에서는 Minus attention이 PSNR 28.405 dB로 가장 높았으나 CW-SSIM이 감소하였다. 최종 구조는 PSNR 26.508 dB, CW-SSIM 0.876, NCC 0.943으로 균형적인 성능을 보였다.

Fig. 13은 각 조합의 시각적 비교를 보여준다. Minus만 적용 시 edge는 강조되나 잡음이 증가하며, Pixel만 적용 시 구조는 안정적이나 세부 경계가 약해진다. 두 attention 동시 적용 시 가장 균형 잡힌 복원이 이루어진다.

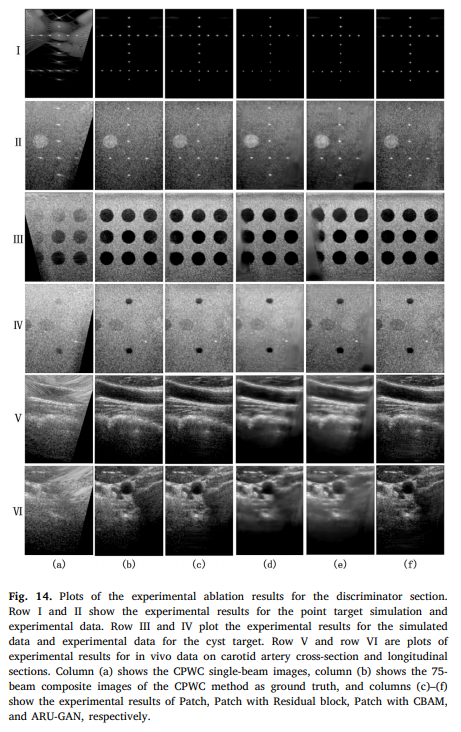

Ablation experimnets for discriminator

판별기 ablation은 Patch 단독, Patch+Residual, Patch+CBAM, Patch+Residual+CBAM(RAPD) 네 조건으로 수행되었으며 해당 결과는 Table 10에 정리되어 있다.

Point target에서 Patch 단독은 0.305/0.525 mm였다. Residual 또는 CBAM만 추가하면 오히려 FWHM이 악화되었다. 그러나 두 모듈을 함께 사용하면 0.277/0.424 mm로 대폭 개선되었다.

Cyst target에서는 Patch 단독이 CNR 6.089/4.319 dB로 높았으나, CR은 38.858/29.212 dB였다. 최종 RAPD는 CR 39.472/26.900 dB, CNR 5.141/3.693 dB로 구조적 대비를 안정화하였다.

In-vivo에서는 Patch 단독이 CW-SSIM 0.608에 불과했으나, RAPD는 PSNR 26.508 dB, CW-SSIM 0.876, NCC 0.943로 크게 향상되었다.

Fig.14는 시각적 비교를 보여준다. Residual 또는 CBAM 단독 적용 시 foreground-background 분리가 불균형해지며 contrast 왜곡이 발생한다. 두 모듈을 결합한 Res-Att 블록은 고주파 판별력과 저주파 보존을 동시에 달성한다.

Ablation experiments for loss function

손실함수 ablation은 BCE 단독, BCE+Perceptual, BCE+MS-SSIM, 세 가지 모두 결합(최종)으로 수행되었으며 해당 결과는 Table 11에 정리되었다.

Point target에서 BCE 단독은 0.333/0.571 mm로 가장 열악했다. Perceptual 추가 시 0.300/0.525 mm로 개선되었고, MS-SSIM 추가 시 0.299/0.505 mm로 추가 개선되었다. 최종 조합은 0.277/0.424 mm로 최저값을 기록하였다.

Cyst target에서는 BCE 단독 CR이 35.076/23.581 dB였다. MS-SSIM 추가 시 36.589/25.421 dB로 개선되었으며, 최종 조합은 39.472/26.900 dB로 최고 성능을 달성하였다.

In-vivo에서는 Perceptual 추가 시 PSNR 29.837 dB로 크게 증가했으나 CW-SSIM이 낮았다. MS-SSIM 추가 시 CW-SSIM이 0.889로 크게 개선되었다. 최종 조합은 PSNR 26.508 dB, CW-SSIM 0.876, NCC 0.943로 구조적·지각적 균형을 달성하였다.

Fig.15는 각 손실 조합의 시각적 결과를 보여준다. BCE 단독은 블러가 심하며, Perceptual만 추가 시 과도한 highlight가 발생한다. MS-SSIM은 구조를 안정화하지만 texture가 부족하다. 세 손실의 결합이 가장 자연스러운 복원을 보인다.

결과 해석

본 연구는 평면파 초음파 영상의 초해상도 재구성을 위해 주파수 분리 기반 attention과 잔차 판별 구조를 결합한 ARU-GAN을 제안하였다. 실험 결과 각 모듈은 고주파 복원, 대비 향상, 구조 보존에 서로 다른 방식으로 기여함을 확인하였다.

Contribution of modules

FSUG는 다중 스케일 skip-connection을 통해 전역 구조와 국소 특징을 동시에 활용하는 기반 구조로 작동하였다. 단독 사용 시 안정적이지만 성능은 제한적이었다. Minus attention은 고주파 민감도를 높여 경계와 texture 복원에 기여했으나 단독 적용 시 노이즈 증폭과 불안정성이 나타났다. 반면 Pixel attention은 전역 저주파 정보를 강화하여 cyst와 같은 저대비 구조에서 대비 안정성을 향상시켰다. 두 attention을 동시에 적용하면 고주파-저주파 균형이 재조정되며 point target과 cyst 모두에서 최적 성능을 보일 수 있었다.

판별기 측면에서는 Patch 구조 단독 사용 시 국소 texture 판별은 가능하지만 구조적 일관성이 부족했다. Residual과 CBAM을 각각 단독 적용하면 정보 분리 불균형이 발생하였으나, Res-Att 블록으로 통합하면 고주파 판별력과 저주파 보존이 동시에 강화되었다. 손실함수 또한 BCE 단독으로는 시각적 품질이 낮았으나 perceptual과 MS-SSIM을 결합함으로써 픽셀·구조·지각 수준의 복원이 균형을 이루었다. 본 모델은 단일 구성요소가 아닌 모듈 간 상호 보완적 결합을 통해 성능 향상을 달성할 수 있었다.

Quality of the model

ARU-GAN은 deep learning 기반 재구성 방법들(SRGAN, VDSR, ResGAN, UnetGAN, AUGAN)과 비교하여 전반적으로 우수한 성능을 보였다. 특히 point target 실험 데이터에서 가장 낮은 FWHM을 기록하며 공간 해상도 측면에서 경쟁력을 입증하였다. Cyst target에서는 CR과 CNR이 동시에 향상되어 대비 복원 능력이 강화되었으며, 이는 pixel attention의 저주파 보강 효과와 minus attention의 경계 강조 효과가 결합된 결과로 해석된다.

In-vivo 실험에서는 PSNR, CW-SSIM, NCC 모두 최고 성능을 달성하였다. 특히 CW-SSIM과 NCC의 향상은 단순 픽셀 유사도 이상의 구조적 일관성 복원을 의미한다. 다만, 전통적 빔포밍 기법과 비교 시 PSNR에서 일부 열세가 관찰되었다. 이는 전통 방법이 beam-domain 물리 정보를 직접 활용하는 반면 본 연구는 image-domain 학습에 집중했기 때문이다. 그럼에도 불구하고 시각적 품질과 구조 보존 측면에서는 충분한 경쟁력을 보였다.

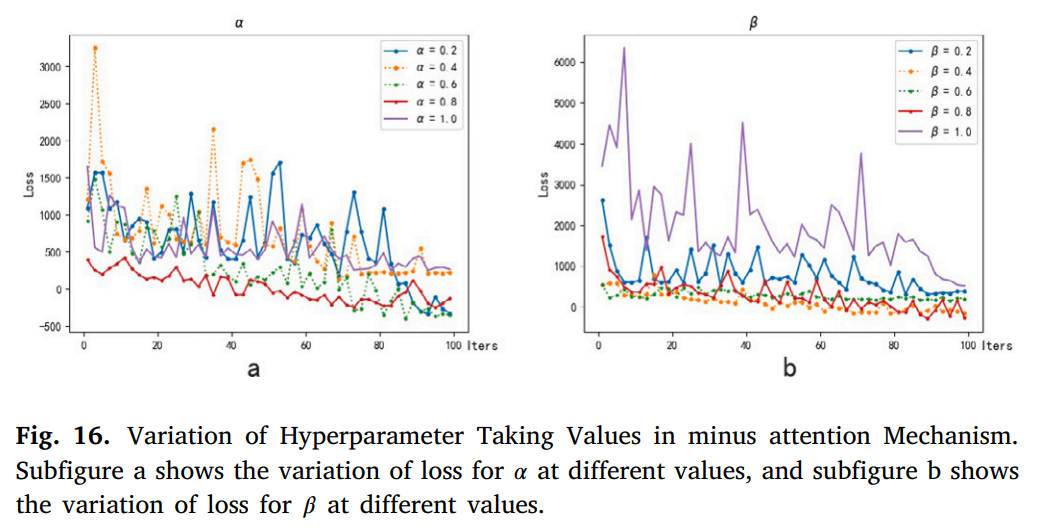

Parameter comparison in minus attention mechanism

Minus attention의 하이퍼파라미터 α, β는 고주파 강조 강도를 조절하는 요소이다.

Fig.16은 α와 β 값을 0~1 범위에서 0.2 간격으로 변화시켰을 때의 loss 수렴 양상을 보여준다. α가 0.8일 때 가장 안정적이며 gradient 변동이 명확하고 발산이 발생하지 않았다. β 또한 0.8에서 최적 수렴을 보였다.

α 값이 낮으면 고주파 잔차가 충분히 반영되지 않아 경계 복원이 약화되며, 과도하게 높으면 노이즈까지 증폭될 위험이 있다. β는 max pooling 기반 sparse 고주파 보강 계수로 작용하며, 낮으면 texture 표현이 약화되고 높으면 불안정성이 증가한다. α=β=0.8 설정은 고주파 보강과 안정적 수렴 사이의 균형점으로 해석된다.

이 결과는 minus attention이 단순 연산 모듈이 아니라, 주파수 가중 균형을 조절하는 민감한 구조임을 보여준다. 즉, 적절한 계수 선택이 모델의 시각적 품질과 안정성에 직접적인 영향을 미친다.

Conclusion

본 연구는 평면파 초음파 영상의 초해상도 재구성을 위해 ARU-GAN을 제안하였다. FSUG 기반 생성기와 Res-Att 기반 판별기를 결합하고 minus 및 pixel attention을 통해 고주파–저주파 정보를 분리·통합하였다. 또한 BCE, perceptual, MS-SSIM을 결합한 복합 손실함수를 적용하여 분포 정합성과 구조적 유사성을 동시에 최적화하였다.

ARU-GAN은 point, cyst, in-vivo 데이터 전반에서 기존 딥러닝 및 전통적 방법 대비 경쟁력 있는 성능을 보였다. 특히 구조 유사성 및 대비 복원에서 우수하였다. 그러나 beam-domain 정보를 직접 활용하지 못한다는 한계와 학습 데이터 요구량이 크다는 제약이 존재한다. 향후 연구에서는 물리적 신호 정보의 통합과 경량화 구조 설계를 통해 성능 및 효율성을 동시에 개선할 필요가 있다.

댓글